L’IA sur Appareil en 2026 : Tout Ce Que Vous Devez Savoir Sur la Révolution des NPU

L’intelligence artificielle n’a plus besoin de vivre dans le cloud. En 2026, une transformation silencieuse mais profonde s’opère dans nos appareils électroniques : l’IA locale, ou Edge AI, s’installe directement sur nos smartphones, ordinateurs portables et objets connectés. Au cœur de cette révolution, le NPU (Neural Processing Unit), un processeur dédié aux calculs d’intelligence artificielle, devient le composant le plus stratégique de nos appareils.

Mais concrètement, que change cette IA sur appareil pour l’utilisateur quotidien ? Pourquoi les fabricants de puces investissent-ils des milliards dans ces cœurs spécialisés ? Et surtout, comment cette technologie redéfinit-elle notre rapport à la vie numérique ? Décryptage complet.

Qu’est-ce que l’IA sur Appareil (Edge AI) ?

L’intelligence artificielle sur appareil, aussi appelée Edge AI ou on-device AI, désigne la capacité d’un appareil à exécuter des modèles d’intelligence artificielle localement, sans envoyer les données vers un serveur distant. Contrairement à l’approche traditionnelle où chaque requête IA nécessite un aller-retour vers le cloud, l’Edge AI permet un traitement instantané directement sur le silicium de l’appareil.

Cette approche présente plusieurs avantages décisifs. La latence est réduite à néant : là où une requête vers un assistant IA cloud peut prendre plusieurs secondes, une fonctionnalité IA locale répond en temps réel. La confidentialité est renforcée, car les données personnelles — photos, messages, conversations — ne quittent jamais l’appareil. L’autonomie est également améliorée grâce à des algorithmes optimisés pour consommer moins d’énergie. Enfin, l’IA sur appareil fonctionne même sans connexion internet.

Le NPU : Le Cœur de la Révolution IA Locale

Le Neural Processing Unit (NPU) est un coprocesseur spécialisé dans les calculs matriciels requis par les réseaux de neurones artificiels. Contrairement au CPU (processeur central) qui exécute des instructions séquentielles et au GPU (processeur graphique) optimisé pour le parallélisme massif, le NPU est architecturé spécifiquement pour les opérations d’apprentissage automatique : multiplication de matrices, activations de neurones, inférences en cascade.

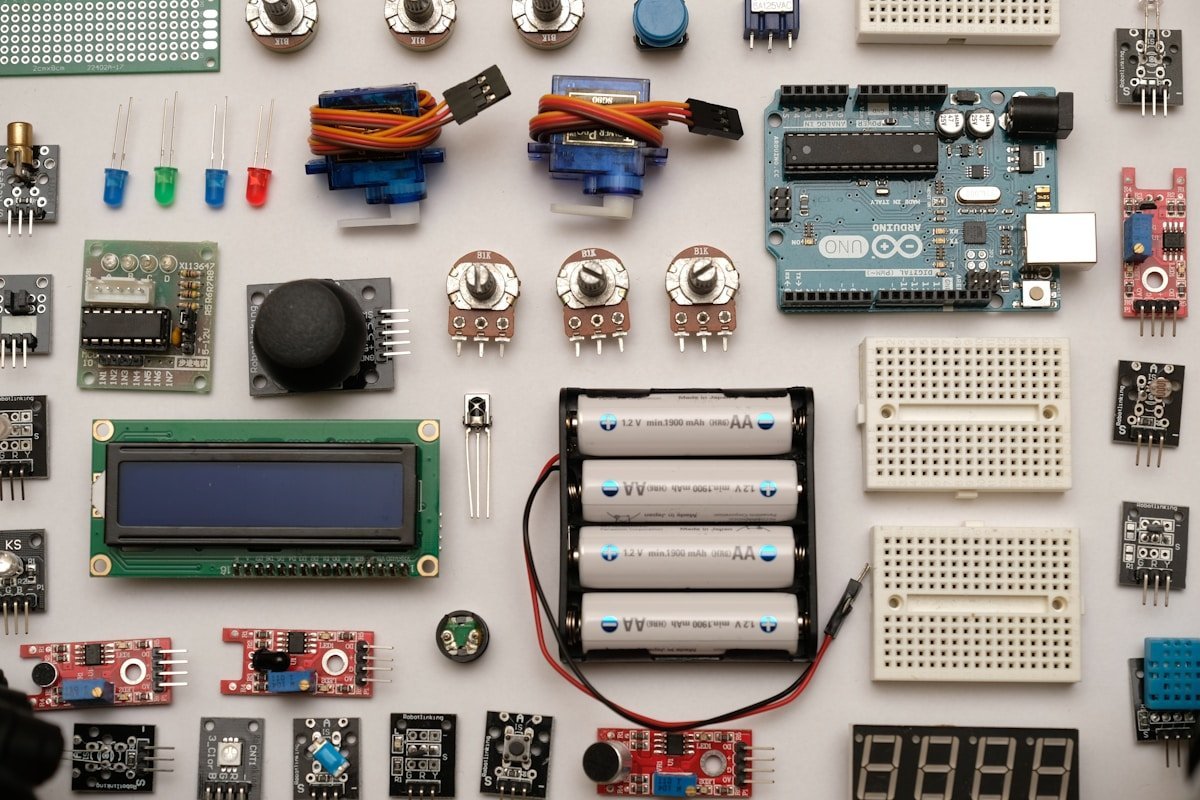

Photo : Unsplash

En 2026, les NPU des principaux acteurs de la puce mobile atteignent des performances impressionnantes. L’Apple Neural Engine de la puce A19 Pro, gravée en 3 nm, promet jusqu’à 45 000 milliards d’opérations par seconde (TOPS) pour les tâches d’IA. Le Qualcomm Hexagon NPU du Snapdragon 8 Elite Gen 6 dépasse les 75 TOPS. Le NPU du Samsung Exynos 2600 (premier SoC mobile gravé en 2 nm GAA) offre des performances de pointe pour les tâches Galaxy AI. Chez MediaTek, le Dimensity 9500 intègre un NPU 8.0 capable de gérer des modèles comprenant jusqu’à 70 milliards de paramètres directement sur l’appareil.

Les Chiffres Clés des NPU en 2026

Les chiffres de performance des NPU ont connu une croissance explosive. En l’espace de trois ans, la puissance brute des unités neurales sur smartphone est passée de quelques milliers de TOPS à près de 50 000 TOPS sur les flagships de 2026. Cette progression est rendue possible par la gravure en 3 nm puis 2 nm, qui permet d’intégrer davantage de cœurs neuronaux sur une surface de silicium équivalente.

Mais au-delà des TOPS, c’est l’efficacité énergétique qui marque la différence. Un NPU moderne consomme jusqu’à 80 % moins d’énergie qu’un CPU généraliste pour effectuer les mêmes calculs d’IA. Cette efficacité se traduit directement en autonomie pour l’utilisateur : les fonctionnalités IA avancées ne vident plus la batterie en quelques minutes.

Les Cas d’Usage Qui Changent le Quotidien

En 2026, l’IA sur appareil n’est plus un argument marketing : elle se retrouve dans des centaines de scénarios concrets que les utilisateurs rencontrent chaque jour.

Photographie Computationnelle Avancée

Le domaine où l’IA locale est la plus visible reste la photographie. Les algorithmes de photographie computationnelle — reconnaissance de scènes, mode nuit, astrophotographie, optimisation des couleurs — fonctionnent désormais entièrement en local. Sur un smartphone haut de gamme de 2026, chaque photo prise déclenche des billions d’opérations IA pour fusionner plusieurs expositions, réduire le bruit et améliorer les détails, sans qu’aucune donnée ne soit envoyée vers un serveur.

Traduction et Transcription Locales

La traduction automatique neuronale sur appareil atteint en 2026 une qualité comparable aux services cloud des années précédentes. Les modèles comme Apple Intelligence ou Galaxy AI traduisent conversations, documents et images en temps réel, sans connexion internet. Cette capacité est particulièrement appréciée en voyage, où l’accès aux données peut être coûteux ou impossible.

Assistants Vocaux Nouvelle Génération

Les assistants vocaux nouvelle génération tirent pleinement parti des NPU pour comprendre des requêtes complexes, maintenir des conversations contextuelles et exécuter des actions multi-étapes. Siri 2.0, attendu à la WWDC 2026, exploitera le Neural Engine de l’A19 Pro pour des interactions plus naturelles et une compréhension du langage naturel nettement améliorée. L’assistant de Samsung, intégré à Galaxy AI, peut désormais gérer des tâches complexes comme la rédaction et l’envoi d’e-mails ou la gestion de calendrier, le tout localement.

Photo : Unsplash

Productivité Augmentée par l’IA sur PC

Sur PC et Mac, les processeurs Copilot+ PC intégrant des NPU dédiés (Intel Core Ultra 200H, Snapdragon X Elite 2) permettent d’exécuter des modèles de langage compacts pour la synthèse de documents, la relecture orthographique avancée et l’assistance à la programmation — sans dépendre du cloud. Windows 12 et ses fonctionnalités IA profondément intégrées au système exploitent ces NPU pour des tâches comme la suppression automatique d’objets dans les images, la transcription de réunions ou la traduction en temps réel.

Les Limites de l’IA sur Appareil

Malgré ses progrès impressionnants, l’Edge AI ne remplace pas entièrement le cloud. Les modèles de langage les plus puissants — dépassant les 100 milliards de paramètres — restent trop volumineux pour être stockés sur un appareil mobile. L’IA sur appareil excelle dans les tâches ciblées et les modèles compacts, mais les calculs massifs (entraînement de modèles, analyses à grande échelle) demeurent l’apanage des data centers.

Une autre limite concerne la personnalisation des modèles. Alors qu’un modèle cloud peut s’adapter continuellement aux préférences de l’utilisateur, les modèles locaux doivent être entraînés sur l’appareil via des techniques de federated learning, encore en phase de maturation. Le compromis entre personnalisation et confidentialité reste un axe d’innovation majeur pour les années à venir.

Perspectives : Vers une IA Ubiquitaire

La trajectoire est claire : d’ici 2027-2028, la majorité des tâches IA grand public seront exécutées localement sur l’appareil. Les NPU deviendront aussi essentiels que le CPU ou le GPU dans la définition des performances d’un appareil. Cette évolution transformera non seulement l’expérience utilisateur, mais aussi l’industrie du silicium, avec des implications majeures pour la confidentialité, la consommation énergétique et la souveraineté numérique.

Les grandes entreprises tech l’ont bien compris. Apple, Qualcomm, Samsung, MediaTek et Intel investissent des milliards dans le développement de NPU toujours plus puissants et efficients. La bataille du silicium IA est désormais aussi stratégique que la guerre des gigahertz des années 2000.

Questions Fréquentes

Qu’est-ce qu’un NPU et en quoi diffère-t-il d’un CPU ou GPU ?

Le NPU (Neural Processing Unit) est un processeur spécialisé dans les calculs d’intelligence artificielle, notamment les opérations matricielles requises par les réseaux de neurones. Contrairement au CPU (généraliste) et au GPU (parallélisme graphique), le NPU est optimisé pour les charges de travail IA avec une efficacité énergétique supérieure pouvant atteindre 80 % d’économie d’énergie sur les mêmes tâches.

L’IA sur appareil est-elle aussi performante qu’une IA sur cloud ?

Pour les tâches ciblées (reconnaissance d’images, traduction, assistants vocaux), l’IA sur appareil atteint des performances comparables au cloud. Pour les tâches complexes nécessitant de très grands modèles (plus de 100 milliards de paramètres), le cloud reste supérieur — mais l’écart se réduit rapidement grâce aux avancées en compression de modèles et en efficacité des NPU.

Mes données sont-elles vraiment protégées avec l’IA locale ?

L’IA sur appareil offre un niveau de protection de la vie privée nettement supérieur, car les données ne quittent jamais le téléphone ou l’ordinateur. Aucune donnée personnelle n’est transmise à un serveur externe pour traitement. C’est l’un des arguments les plus forts en faveur de l’Edge AI.

Quels appareils en 2026 intègrent les meilleurs NPU ?

Les smartphones les plus récents (iPhone 17 Pro avec A19 Pro, Samsung Galaxy S26 Ultra avec Exynos 2600, Xiaomi 17 Ultra avec Snapdragon 8 Elite Gen 6) et les PC Copilot+ (Intel Core Ultra 200H, Snapdragon X Elite 2, AMD Ryzen AI Max+) intègrent les NPU les plus puissants du marché, dépassant tous les 40 TOPS.

L’IA sur appareil fonctionne-t-elle hors ligne ?

Oui, c’est l’un de ses avantages majeurs. Contrairement aux assistants IA cloud, les fonctionnalités IA locales fonctionnent intégralement hors connexion internet, ce qui est particulièrement utile en voyage ou dans les zones à faible connectivité.

Conclusion

L’intelligence artificielle sur appareil n’est plus une promesse lointaine : elle est là, dans nos poches, sur nos poignets et dans nos sacs. En 2026, le NPU s’impose comme le composant stratégique de la révolution IA, rendant les appareils plus rapides, plus privés et plus intelligents. Cette tendance n’en est qu’à ses débuts — et les prochaines années promettent des avancées encore plus spectaculaires. Pour rester informé des innovations technologiques qui façonnent notre quotidien, découvrez nos autres articles sur l’écosystème Tech & AI sur Authoritaire.com.