DeepSeek vient de frapper fort. Alors que le monde attendait GPT-5, c’est le laboratoire chinois DeepSeek qui a pris tout le monde de court avec V4, un modèle de langue de 1 000 milliards de paramètres conçu pour rivaliser avec les meilleures intelligences artificielles du monde entier. Cette annonce marque un tournant dans la course à l’IA et soulève des questions cruciales sur la indépendance technologique, les coûts de formation et l’avenir de l’IA open source.

Qu’est-ce que DeepSeek V4 ?

DeepSeek V4 est le dernier né des grands modèles de langage développés par DeepSeek, le laboratoire chinois d’intelligence artificielle qui a déjà surpris l’industrie avec ses modèles V3 et R1. Avec environ 1 000 milliards de paramètres, il surpasse nettement les 671 milliards de V3, tout en activant moins de paramètres par token utilisé — environ 32 milliards contre 37 milliards — ce qui le rend plus efficace et moins coûteux en inférence.

Une fenêtre de contexte de 1 million de tokens

L’une des avancées les plus spectaculaires de DeepSeek V4 réside dans sa fenêtre de contexte de 1 million de tokens. Contrairement à V3 qui se limitait à 128 000 tokens, V4 permet d’analyser des documents entiers, des bases de code complètes ou des corpus de recherche en une seule requête. Cette capacité redéfinit les possibilités pour les professionnels : un développeur peut soumettre l’ensemble d’un dépôt GitHub pour une revue de code complète, ou un analyste financier peut charger quatre rapports trimestriels consécutifs pour une analyse de tendances approfondie.

Une architecture multimodale native

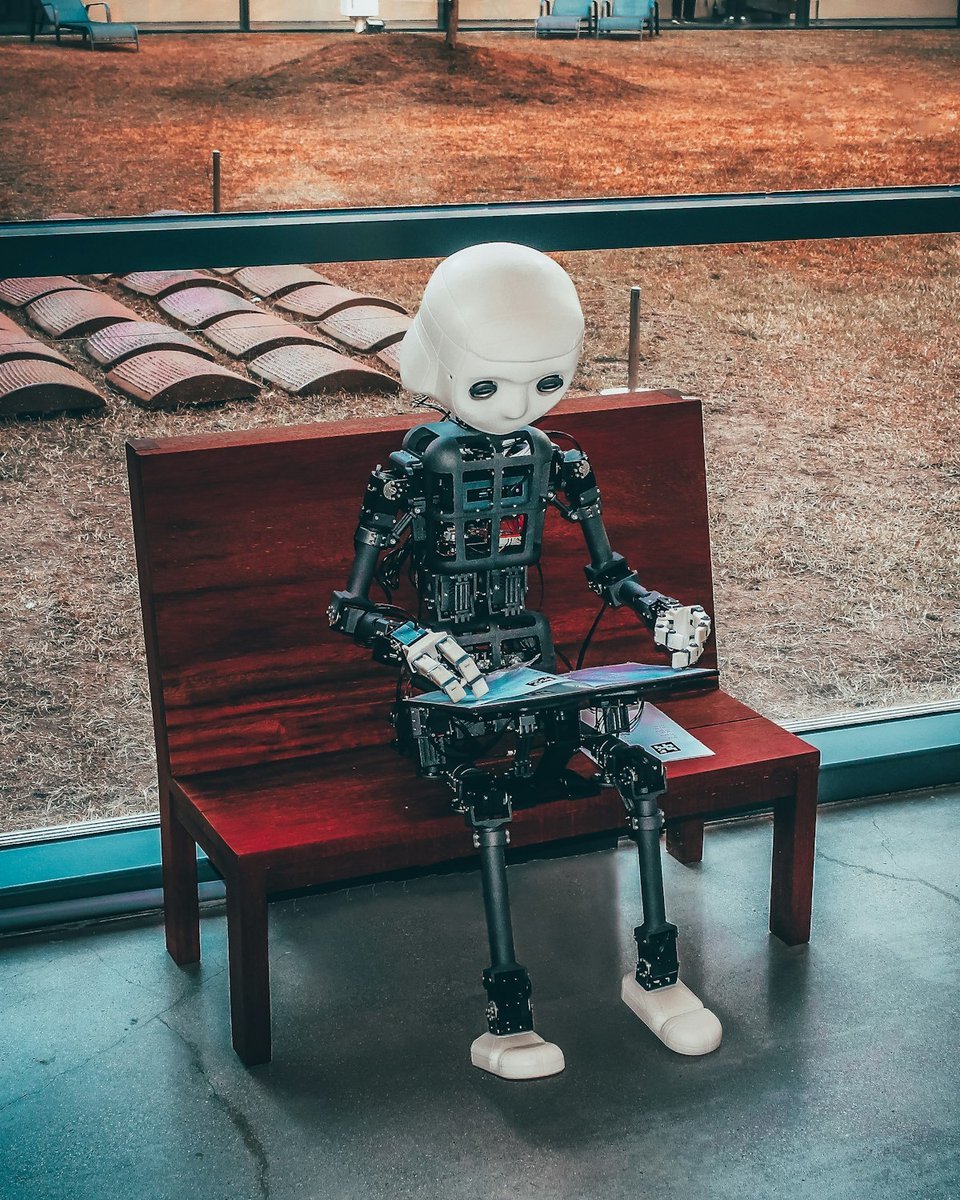

Contrairement à V3, uniquement textuel, DeepSeek V4 est conçu dès le départ comme un modèle multimodal. Textes, images, vidéos — tout est intégré nativement pendant l’entraînement, plutôt qu’ajouté a posteriori. Cela signifie une compréhension plus profonde des relations entre les différentes modalités et des capacités de génération plus cohérentes.

Performance et benchmarks

Si les benchmarks officiels n’ont pas encore été publiés, des fuites internes circulent déjà dans la communauté :

- HumanEval (évaluation de code) : 90%, un score qui placerait V4 au-dessus de la plupart des modèles concurrents

- SWE-bench (résolution de bugs réels) : au-dessus de 80%, suggérant des capacités pratiques en ingénierie logicielle

Selon ces mêmes fuites, DeepSeek V4 surpasserait Claude et GPT sur les tâches de programmation. Une performance d’autant plus remarquable que le coût de formation de V4 reste extrêmement compétitif par rapport aux standards de l’industrie.

Le virage Huawei : l’indépendance vis-à-vis de Nvidia

L’un des aspects les plus stratégiques de DeepSeek V4 concerne le matériel. Alors que V3 a été entraîné sur des GPU Nvidia H800, V4 marque un tournant : le modèle serait désormais optimisé pour fonctionner sur les puces Huawei Ascend 910B et 910C. DeepSeek aurait obtenu un accès précoce aux puces Huawei — un privilège qui n’a pas été étendu à Nvidia ou AMD. Si cela se confirme, DeepSeek V4 deviendrait le premier modèle de 1 000 milliards de paramètres optimisé entièrement en dehors de l’écosystème Nvidia.

Cas d’usage professionnels

Assistant de programmation d’entreprise

Avec un score de 90% sur HumanEval et une fenêtre de contexte de 1 million de tokens, V4 pourrait analyser des bases de code entières en une seule requête. Pour une équipe de développement, cela signifie la capacité de soumettre un dépôt GitHub complet et de demander une revue de code, des suggestions de refactorisation ou une détection de vulnérabilités à travers l’ensemble du projet.

Analyse de documents à grande échelle

Les cabinets d’avocats pourraient soumettre un dossier complet de litige et demander au modèle d’identifier chaque clause liée aux limitations de responsabilité ou aux indemnités, en croisant des dizaines de pièces et d’amendements. Les équipes conformité pourraient traiter un cadre réglementaire complet aux côtés de leurs politiques internes en une seule requête.

Création de contenu multimodal

Pour les équipes marketing et les créateurs de contenu, les capacités multimodales natives ouvrent des possibilités sans précédent. Un responsable marketing pourrait fournir au modèle une fiche technique produit et des directives de marque, puis demander un brouillon d’article de blog, trois variantes visuelles pour les réseaux sociaux et une animation teaser de 15 secondes — le tout cohérent et aligné avec la même brief.

Coût et auto-hébergement

Sous licence MIT, V4 serait entièrement auto-hébergeable. Les entreprises soumises à des contraintes réglementaires strictes — santé, défense, finance — pourraient ainsi garder leurs données sur leurs propres serveurs, un avantage majeur pour la conformité GDPR sans dépendre de fournisseurs américains. L’investissement matériel pour un auto-hébergement complet se situe entre 50 000 et 200 000 dollars selon la configuration, mais l’API DeepSeek offre une alternative bien plus accessible.

Disponibilité et date de sortie

DeepSeek V4 n’a pas encore été officiellement publié. Si plusieurs dates de lancement ont été anticipées par la communauté, aucune ne s’est concrétisée à ce jour. DeepSeek maintient une communication évasive, laissant le mystère s’épaissir. Ce qui est certain, c’est que le modèle sera disponible en open source, et qu’il représentera l’un des lancements les plus importants de l’année 2026 dans le domaine de l’intelligence artificielle.

Conclusion

DeepSeek V4 s’annonce comme l’un des modèles d’IA les plus ambitieux de 2026. Avec 1 000 milliards de paramètres, une fenêtre de contexte de 1 million de tokens, des capacités multimodales natives et une licence open source, il coche toutes les cases qui comptent pour les professionnels et les développeurs. La dépendance aux puces Huawei ajoute une dimension géopolitique fascinante à cette histoire. Jusqu’à sa sortie officielle, nous ne disposons que de fuites et de rumeurs — mais la trajectoire de DeepSeek, qui a surpris l’industrie avec V3 et R1, prête crédibilité à ces promesses.

FAQ

DeepSeek V4 est-il open source ?

DeepSeek V4 devrait être publié sous licence MIT, ce qui signifie un auto-hébergement complet et gratuit pour les entreprises.

Quelle est la différence entre DeepSeek V4 et GPT-4o ?

DeepSeek V4 se distingue par sa fenêtre de contexte de 1 million de tokens (contre 128 000 pour GPT-4o), son architecture multimodale native et son efficacité computationnelle accrue grâce à la réduction des paramètres actifs par token.

Sur quel matériel DeepSeek V4 est-il entraîné ?

V4 serait optimisé pour les puces Huawei Ascend 910B et 910C, marquant un tournant avec la domination de Nvidia dans le domaine de l’entraînement IA.

DeepSeek V4 est-il déjà disponible ?

DeepSeek V4 n’a pas encore été officiellement lancé. Les fuites et les rumeurs indiquent un lancement imminent, potentiellement au premier trimestre 2026.

Combien coûte l’API DeepSeek V4 ?

Les prix de l’API n’ont pas encore été annoncés. DeepSeek a historiquement proposé des tarifs très compétitifs par rapport à OpenAI et Anthropic.