En mars 2025, NVIDIA a officiellement lance sa plateforme Blackwell Ultra, marquant une nouvelle etape dans l’evolution des accelerateurs IA pour les centres de donnees. Cette nouvelle generation, centree sur le GPU GB300, promet des gains massifs en performance pour l’inference et le raisonnement automatise, consolidant la position dominante de NVIDIA face a AMD, Intel et les puces personnalisees des hyperscalers.

Qu’est-ce que Blackwell Ultra ?

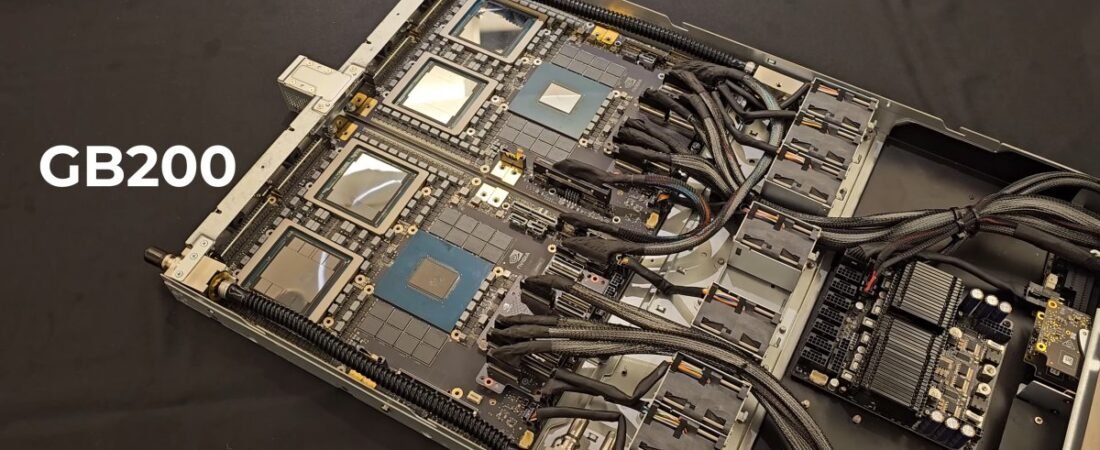

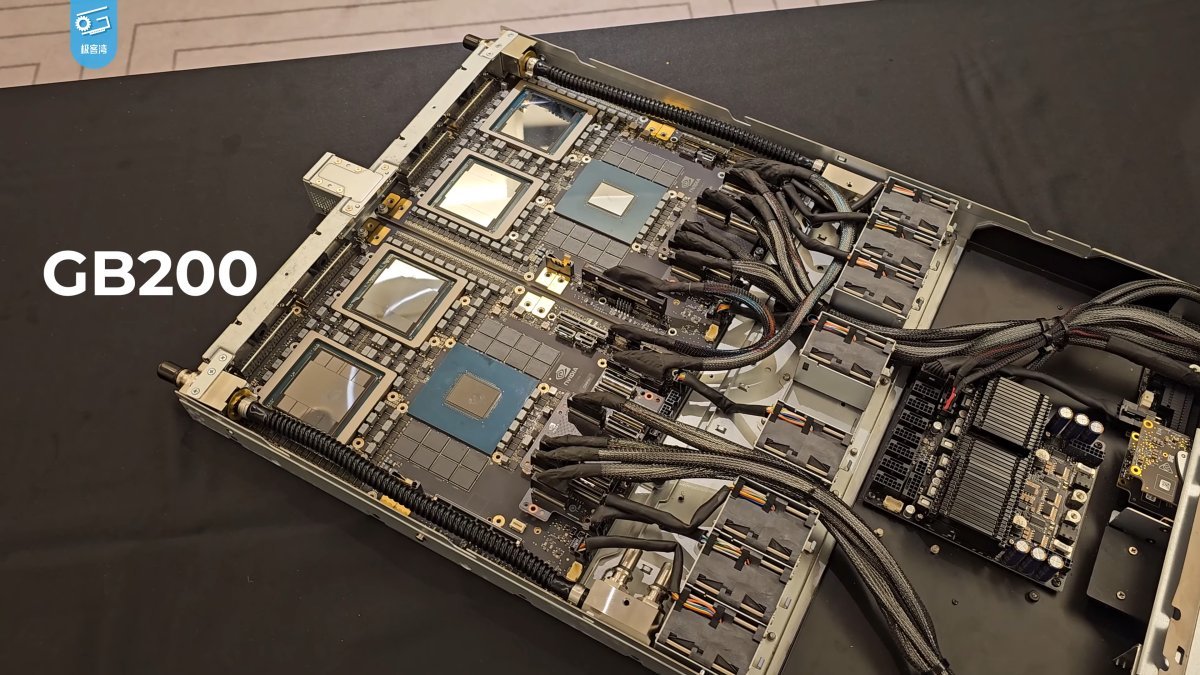

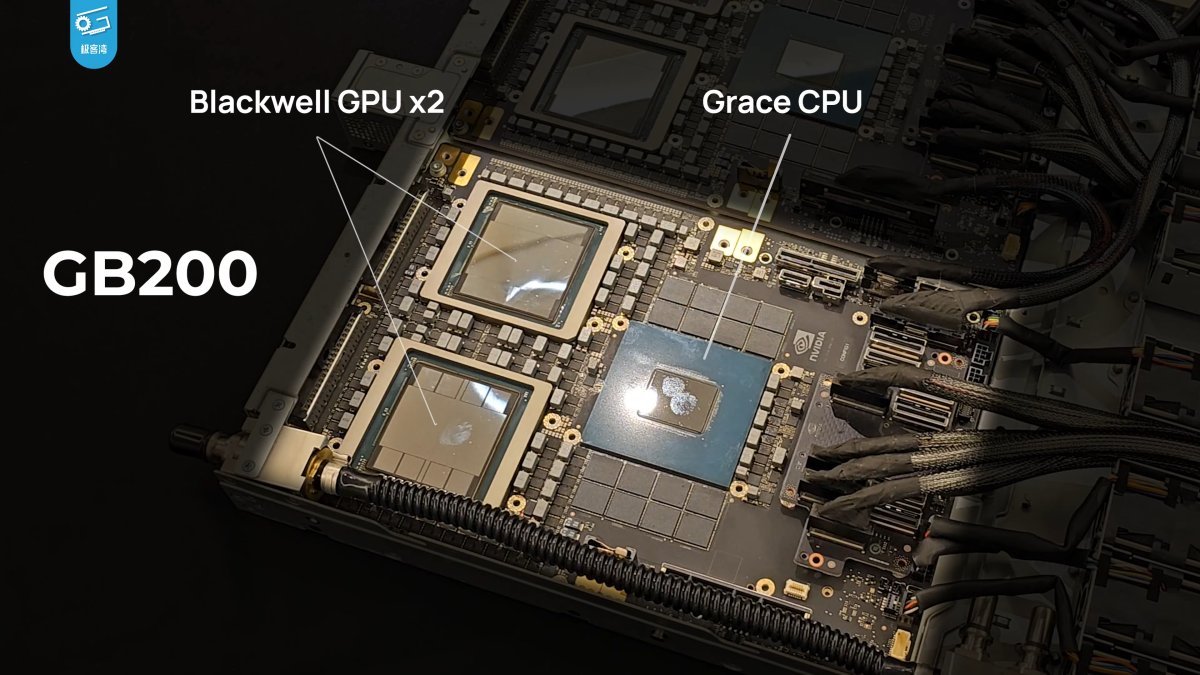

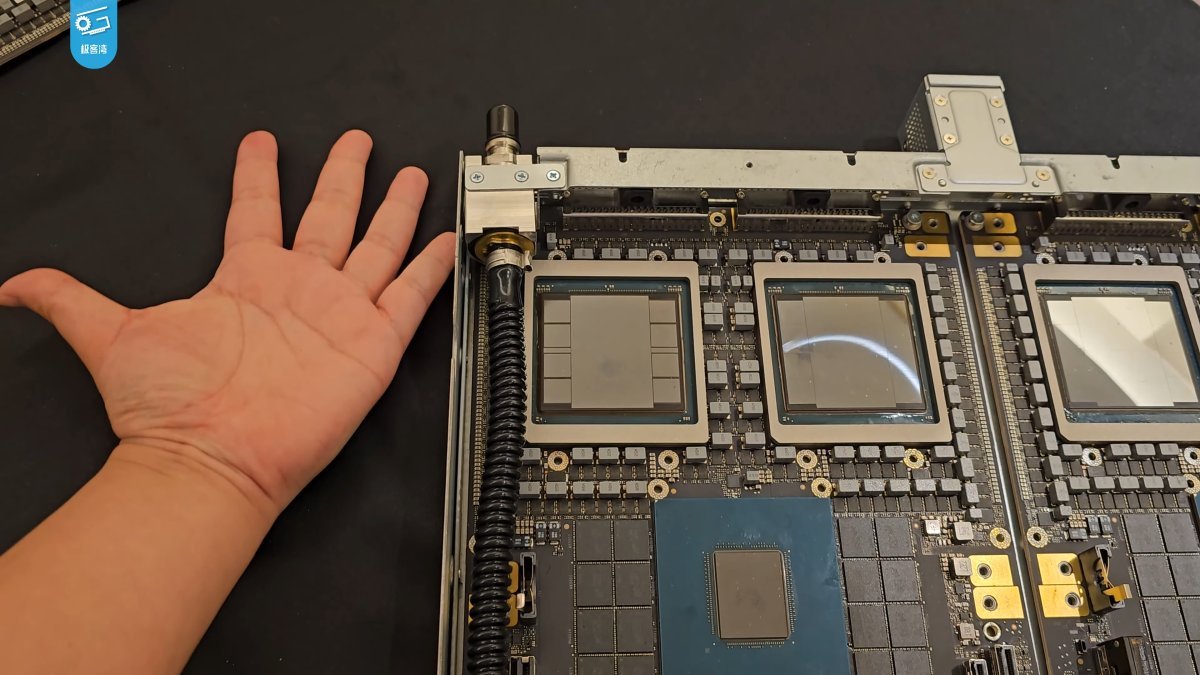

Blackwell Ultra est une evolution de l’architecture Blackwell originale, introduite en mars 2024. Le nom « Ultra » designate specifiquement la plateforme NVL72, un systeme rack-scale qui mutualise 72 GPU GB300 et 36 CPU NVIDIA Grace, le tout relie par des connexions NVLink 5.0 offrant une bande passante de 1,8 To/s par GPU.

Chaque GPU GB300 integre 288 Go de memoire HBM3e, permettant de traiter des modeles de plus grande taille directement en memoire, sans avoir a recourir a des techniques de partitionnement qui degradent les performances. Cette capacite memoire massive est cruciale pour les workloads d’inference impliquant des modeles a plusieurs centaines de milliards de parametres.

Le concept d’AI Factory

Jensen Huang, PDG de NVIDIA, qualifie Blackwell Ultra de « usines a tokens ». L’idee est simple : au lieu de simplement executer des modeles, ces systemes sont concus pour produire de l’intelligence a grande echelle. Le concept d’AI Factory repose sur une integration materielle/logicielle ou le silicium, le reseau et les frameworks sont co-optimises pour maximiser le debit d’inference.

Sur le plan logiciel, SemiAnalysis a demontre que les optimisations de pilotes NVIDIA combinees aux systemes GB300 NVL72 peuvent multiplier par 50 les performances par watt sur certains workloads de raisonnement IA. Cette efficacite energetique devient critique alors que la consommation electrique des centres de donnees IA explose.

Performances comparees

En benchmark MLPerf Inference v4.0, les systemes Blackwell Ultra ont systematiquement domine les generations precedentes et la concurrence. Les resultats montrent des gains de 30 a 50 % sur les taches de raisonnement multi-etapes par rapport a la plateforme H200.

Le GPU GB300 propose des Tensor Cores de nouvelle generation avec une acceleration des couches d’attention deux fois superieure a la generation Blackwell classique, et 1,5 fois plus de FLOPS IA. Cette amelioration profite particulierement aux modeles de langage de grande taille (LLM) qui passent une partie significative de leur temps de calcul dans les mecanismes d’attention.

Le defi des concurrents

NVIDIA ne dominait plus sans contestation. AMD prepare ses propres accelerateurs MI350X avec architecture CDNA 4, tandis que Google (TPU v6), Amazon (Trainium 3) et Microsoft (Maia 200) developpent leurs propres puces. Ces solutions personnalisees, bien que moins polyvalentes, offrent des avantages de cout pour les workloads specifiques des hyperscalers.

Parallelement, les startups comme Cerebras, Graphcore et Groq proposent des architectures tres specialisees pour l’inference, certaines avec des temps de reponse extremement faibles grace a des approches de memoire on-chip massive.

NVIDIA repond a cette fragmentation en misant sur CUDA, son ecosysteme logiciel proprietaire qui reste le standard de facto pour le developpement IA. La transition vers les frameworks comme TensorRT-LLM et NIM (NVIDIA Inference Microservices) renforce ce verrou logiciel, rendant le changement de plateforme couteux pour les entreprises.

Disponibilite et marche

Les systemes Blackwell Ultra sont livres depuis le second semestre 2025. NVIDIA a signe des partenariats avec tous les grands cloud providers (AWS, Azure, Google Cloud, Oracle) et des entreprises comme Dell, HPE et Lenovo proposent des solutions hybrides combinant CPU/GPU.

Les premiers deploiements se concentrent sur l’inference de modeles de raisonnement (o-series, Claude Think, Grok) ou la puissance memoire et la bande passante NVLink sont determinantes. L’architecture rack-scale de la NVL72 permet de faire tourner des modeles de 1 000 milliards de parametres en continuous batching, maximisant l’utilisation des ressources.

Perspectives et conclusion

Blackwell Ultra incarne la strategie de NVIDIA pour rester en tete de la course a l’IA. En combinant puissance brute, memoire massive et integration logicielle, la plateforme repond aux exigences croissantes des workloads modernes. Cependant, la montee en puissance des puces personnalisees et des alternatives open-source comme ROCm menace progressivement l’hegemonie de CUDA.

Pour les entreprises, le choix se complique : opter pour Blackwell Ultra signifie investir dans un ecosysteme ferme mais teste, tandis que les alternatives offrent plus de flexibilite au prix d’une courbe d’apprentissage plus raide. La decision dependra en grande partie du niveau d’integration souhaite et de la dependance a l’ecosysteme NVIDIA.

En 2026, le marche des accelerateurs IA reste ultra-concurrentiel. NVIDIA garde une longueur d’avance, mais les cartes commencent a se redistribuer.

FAQ

Qu’est-ce qui distingue Blackwell Ultra de la generation Blackwell classique ?

Blackwell Ultra apporte des Tensor Cores ameliores avec une acceleration des couches d’attention doublee, 1,5 fois plus de FLOPS IA, et 288 Go de HBM3e par GPU contre 192 Go precedemment. La plateforme NVL72 mutualise 72 GPU en rack-scale.

Quelle est la consommation electrique d’un systeme GB300 NVL72 ?

Un systeme NVL72 complet consomme environ 120 kW en charge maximale, necessitant un systeme de refroidissement liquide. NVIDIA propose des configurations air-cooled et liquid-cooled selon les centres de donnees.

Blackwell Ultra est-il compatible avec les modeles existants ?

Oui, les frameworks comme TensorRT-LLM, vLLM et Ollama supportent nativement les GPU GB300. La plupart des modeles publics depuis 2024 sont optimises pour l’architecture Blackwell.

Combien coute un systeme Blackwell Ultra ?

NVIDIA ne publie pas de tarif public. Les estimations situent le prix d’une configuration NVL72 complete entre 5 et 10 millions de dollars, reserve aux grands cloud providers et institutions de recherche.