Qu’est-ce que NVIDIA Blackwell Ultra ?

L’architecture NVIDIA Blackwell Ultra représente la dernière évolution majeure de NVIDIA dans le domaine du calcul accéléré pour l’intelligence artificielle. Successeure directe de l’architecture Hopper, Blackwell Ultra a été conçue spécifiquement pour répondre aux exigences computationnelles massives des modèles d’IA de nouvelle génération — ceux capables de raisonnement, d’agentic AI et d’IA physique.

Au cœur de cette architecture, on trouve les GPU NVIDIA GB300, une famille de processeurs graphiques qui pousse les limites de la performance pour les centres de données IA. Le NVL72, qui intègre 72 GPU Blackwell Ultra reliés à 36 CPU NVIDIA Grace, constitue un système de calcul rack-scale agissant comme un unique GPU massif dédié au test-time scaling — une approche qui permet aux modèles d’IA d’explorer différentes voies de résolution de problèmes complexes.

Les spécifications qui redefinissent l’IA

Le NVIDIA GB300 NVL72 delivers 1,5 fois plus de performances IA que son prédécesseuer, le GB200 NVL72, tout en multipliant par 50 les opportunités de revenus pour les Usines IA (AI Factories). Cette avancée repose sur plusieurs innovations clés :

- Mémoire HBM3e+ — jusqu’à 288 Go par GPU, soit une capacité 1,5 fois supérieure à la génération précédente

- Tensor Cores de 5e génération — acceleration des couches d’attention multipliée par 2 par rapport à Blackwell standard

- FP4 compute — 14 petaFLOPS de débit FP4 pour des inférences IA plus rapides et moins coûteuses

- NVLink et NVSwitch — interconnexion haute vitesse permettant une communication optimale entre GPU

- ConnectX-8 SuperNIC — réseau Ethernet 800 Gb/s pour chaque GPU du système

Des AI Factories aux Usines de Raisonnement

Jensen Huang, PDG de NVIDIA, a déclaré lors de l’annonce : « L’IA a fait un bond Giant — le raisonnement et l’agentic AI demandent des ordres de grandeur supplémentaires de performance de calcul. Nous avons conçu Blackwell Ultra pour ce moment — c’est une plateforme unique et polyvalente qui peut facilement et efficacement effectuer le pré-entraînement, le post-entraînement et l’inférence IA de raisonnement. »

Cette déclaration souligne le passage paradigmatique des data centers classiques vers les AI Factories — des infrastructures dédiées non plus au simple stockage ou calcul, mais à la production et au déploiement de modèles d’IA sophistiqués capable de raisonnement.

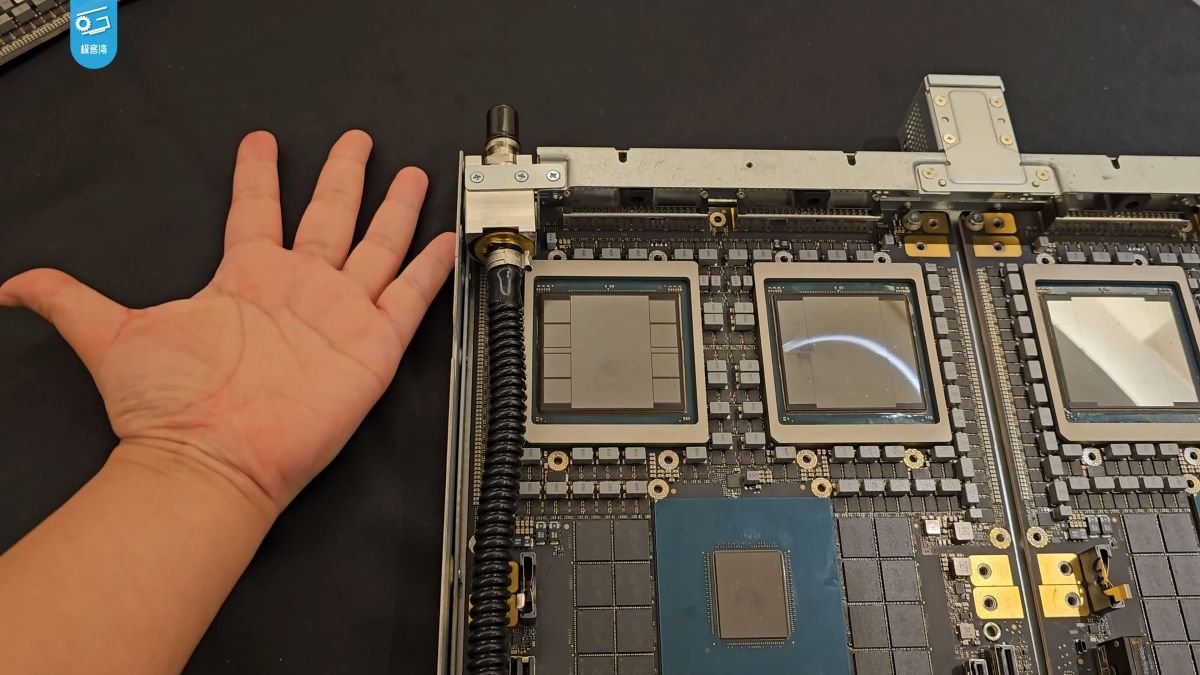

Photo : NVIDIA Newsroom

Le raisonnement IA : la nouvelle frontière

Le concept de test-time scaling constitue le cœur de la stratégie Blackwell Ultra. Contrairement à l’approche traditionnelle qui se concentre sur l’augmentation de la puissance de calcul pendant la phase d’entraînement, le test-time scaling vise à appliquer davantage de ressources computationnelles pendant l’inférence elle-même — c’est-à-dire au moment où le modèle génère sa réponse.

Cette technique permet aux modèles d’IA de « réfléchir » davantage avant de fournir une réponse, décomposant les requêtes complexes en étapes multiples et explorant différentes solutions. Le résultat : des réponses de meilleure qualité, une précision accrue sur les tâches de raisonnement complexe, et une capacité à gérer des problèmes multi-étapes qui seraient impossibles à résoudre en une seule passe.

Les cas d’usage transformés par Blackwell Ultra

L’architecture Blackwell Ultra ouvre la porte à des applications IA previously out of reach :

- Agentic AI — des systèmes capables de raisonnement sophistiqué et de planification itérative pour résoudre autonomement des problèmes complexes multi-étapes. Ces agents ne se limitent plus à suivre des instructions : ils reason, planifient et agissent pour atteindre des objectifs spécifiques.

- Physical AI — la génération en temps réel de vidéos photoréalistes synthétiques pour l’entraînement de robots et de véhicules autonomes à grande échelle.

- Raisonnement mathématique avancé — résolution de problèmes mathématiques de niveau olympiades ou démonstration de théorèmes complexes.

- Analyse juridique et financière — traitement de documents complexes avec capacité de raisonnement contextuel.

Photo : Wikimedia Commons / CC BY-SA

NVIDIA Dynamo : optimiser l’inférence de raisonnement

Alongside matériel innovations, NVIDIA a également annoncé Dynamo, un framework d’inférence open-source conçu pour maximiser la génération de tokens et les revenus des AI Factories déployant des modèles de raisonnement IA. Dynamo orchestre et accélère la communication d’inférence à travers des milliers de GPU, utilisant le serving différencié pour séparer les phases de traitement et de génération des grands modèles linguistiques sur différents GPU.

Cette approche permet d’optimiser indépendamment chaque phase selon ses besoins spécifiques, garantissant une utilisation maximale des ressources GPU. Combined avec les GPU Blackwell Ultra, Dynamo réduit les temps de réponse tout en diminuant les coûts de serving des modèles — un facteur critique pour le déploiement à grande échelle.

Un écosystème de partenaires mondiale

Les systèmes basés sur Blackwell Ultra seront disponibles auprès d’un écosystème impressionnant de partenaires technologiques. Les fabricants de serveurs comme Cisco, Dell Technologies, Hewlett Packard Enterprise, Lenovo et Supermicro proposeront des solutions Blackwell Ultra. Du côté des clouds, Amazon Web Services, Google Cloud, Microsoft Azure et Oracle Cloud Infrastructure proposeront des instances alimentées par Blackwell Ultra.

Among the GPU cloud providers, CoreWeave, Crusoe, Lambda, Nebius, Nscale, Yotta et YTL seront parmi les premiers à offrir des instances Blackwell Ultra — garantissant une large disponibilité pour les développeurs et les entreprises.

Impact sur l’écosystème IA en 2026

L’arrivée de Blackwell Ultra marque un tournant pour l’industrie. Avec une performance 11 fois plus rapide pour l’inférence sur les grands modèles linguistiques et une mémoire 4 fois plus grande que la génération Hopper, cette architecture redefinit ce qui est possible en matière d’IA embarquée dans les centres de données.

Pour les entreprises et les développeurs, cela se traduit par :

- Des temps de réponse divisés par 11 pour les applications d’IA conversationnelle avancées

- Une réduction significative des coûts opérationnels grâce à une efficacité accrue

- La capacité de déployer des modèles de raisonnement complexes à grande échelle

- De nouvelles possibilités pour l’agentic AI et l’automatisation intelligente

Conclusion

L’Nvidia Blackwell Ultra et le GB300 représentent bien plus qu’une simple évolution technologique — ils incarnent le passage à une nouvelle ère du calcul IA, celle où le raisonnement et l’agentic AI deviennent accessibles à grande échelle. Avec des partenaires cloud et matériels engagés à travers le monde, cette architecture s’apprête à accélérer profondément la transformation numérique de secteurs aussi divers que la santé, la finance, l’automobile et la robotique.

Pour suivre l’actualité tech et les analyses approfondies sur les architectures IA de nouvelle génération, consultez notre catégorie Tech dédiée aux innovations technologiques.

FAQ — Questions Fréquentes

Qu’est-ce que le test-time scaling ?

Le test-time scaling est une technique qui applique davantage de puissance de calcul pendant la phase d’inférence d’un modèle d’IA, lui permettant de « réfléchir » plus longtemps avant de générer une réponse. Cela améliore significativement la qualité des réponses pour les tâches de raisonnement complexe.

Quelle est la différence entre Blackwell et Blackwell Ultra ?

Blackwell Ultra est une version améliorée de l’architecture Blackwell originale, offrant des Tensor Cores accelerateés 2 fois, 1,5 fois plus de performances IA compute FLOPS, et jusqu’à 288 Go de mémoire HBM3e+ par GPU.

Quand les systèmes Blackwell Ultra seront-ils disponibles ?

Les produits basés sur Blackwell Ultra sont attendus à partir du second semestre 2025 auprès des principaux fabricants de serveurs et fournisseurs de cloud.

Qu’est-ce qu’une AI Factory ?

Une AI Factory est un data center spécialisé dans la production et le déploiement de modèles d’IA, conçu pour gérer les workloads de raisonnement et d’agentic AI à grande échelle, par opposition aux data centers traditionnels axés sur le stockage ou le calcul générique.

Quel est l’impact de Blackwell Ultra sur l’IA embarquée ?

Avec des performances 11 fois supérieures pour l’inférence et une mémoire 4 fois plus grande que la génération Hopper, Blackwell Ultra permet de déployer des modèles de raisonnement complexes dans des environnements enterprise avec une efficacité énergétique et un coût par token réduits.