L’année 2026 marque un tournant décisif dans la guerre des intelligences artificielles sur mobile. Deux acteurs majeurs s’affrontent : Apple Intelligence 2.0, intégré profondément dans l’écosystème Apple avec iOS 27 et la puce A19 Pro, et Google Gemini 3, le modèle multimodal de Google conçu pour dominer l’écosystème Android. Lequel de ces deux géants propose réellement la meilleure expérience IA sur smartphone ?

Photo : Intelligence artificielle sur smartphone — Libre de droits via Unsplash

Apple et Google ont tous deux fait de l’intelligence artificielle le centre de leur stratégie mobile. Apple mise sur une IA privée, partiellement exécutée sur l’appareil grâce au Neural Engine de la puce A19 Pro, tandis que Google exploite la puissance de ses serveurs cloud et les capacités de son TPU (Tensor Processing Unit) pour offrir des performances encore plus impressionnantes. Les deux approches présentent des avantages et des inconvénients en termes de confidentialité, de rapidité et de fonctionnalités.

Dans cet article, nous analysons en profondeur les capacités d’Apple Intelligence 2.0 et de Google Gemini 3 sur les smartphones de 2026, en examinant leurs performances dans des domaines clés : rédaction assistée, génération d’images, traduction en temps réel, photographie computationnelle, assistance vocale avec Siri 2.0 et Google Assistant Gemini, et bien sûr, l’intégration écosystémique.

Apple Intelligence 2.0 : Une Révolution Silencieuse dans l’Écosystème Apple

Apple Intelligence 2.0 représente le plus grand bond en avant d’Apple dans le domaine de l’intelligence artificielle depuis l’introduction de Siri en 2011. Déployé avec iOS 27, macOS 27 et watchOS 14, ce système repense complètement l’expérience utilisateur en intégrant des capacités d’IA générative directement dans chaque application native d’Apple.

Au cœur d’Apple Intelligence 2.0 se trouve la nouvelle puce A19 Pro, gravée en 3 nanomètres de deuxième génération par TSMC. Cette puce intègre un Neural Engine capable de réaliser jusqu’à 60 billions d’opérations par seconde (TOPS), contre seulement 35 TOPS pour l’A17 Pro. Cette puissance de calcul permet d’exécuter des modèles de langage complexes directement sur l’appareil, sans avoir besoin de recourir au cloud pour la plupart des tâches quotidiennes.

Siri 2.0 : L’Assistant Vocal Qui Apprend à Raisonner

La refonte la plus spectaculaire concerne Siri. Avec Apple Intelligence 2.0, Siri bénéficie enfin d’un modèle de langage de nouvelle génération capable de comprendre des requêtes complexes et multi-étapes. L’assistant vocal peut désormais enchaîner plusieurs commandes dans une même phrase, comprendre le contexte conversationnel sur plusieurs heures de discussion, et même anticiper vos besoins avant que vous ne les formuliez explicitement.

Apple a également ouvert Siri à des services tiers. Dans iOS 27, il sera possible de demander à Siri de réserver un trajet via Uber, d’envoyer un message via WhatsApp, ou de contrôler vos appareils domotiques compatibles Matter, le tout sans quitter l’application en cours d’utilisation. Cette ouverture marque un changement de stratégie majeur pour Apple, historiquement très fermé sur son écosystème.

Fonctionnalités Clés d’Apple Intelligence 2.0

Apple Intelligence 2.0 se distingue par plusieurs fonctionnalités innovantes qui transforment la manière dont les utilisateurs interagissent avec leurs appareils Apple. La rédaction assistée est désormais disponible dans toutes les applications, de Mail à Messages en passant par Notes. L’IA peut rédiger des e-mails complets, résumer de longs documents, reformuler un texte dans un style plus formel ou plus décontracté, et même corriger automatiquement les fautes en proposant des alternatives contextuelles.

Photo : Circuit intégré — Libre de droits via Unsplash

La génération d’images prend également une nouvelle dimension. Avec l’application Image Playground intégrée à iOS 27, les utilisateurs peuvent créer des images générées par IA en quelques secondes. L’outil propose plusieurs styles : animation, illustration, sketch. Les images générées peuvent être insérées directement dans les messages, les posts sur les réseaux sociaux, ou enregistrées dans la photothèque.

La fonctionnalité Visual Intelligence tire parti des caméras de l’iPhone pour analyser le monde réel en temps réel. Pointer son téléphone vers un édifice permet des traductions instantanées, une plante pour obtenir des informations sur l’espèce, ou un monument pour accéder à des informations historiques détaillées. Cette fonctionnalité exclusive à l’écosystème Apple démontre la volonté d’Apple de créer une expérience IA cohérente et profondément intégrée.

Confidentialité : Le Pari d’Apple sur l’IA Locale

Apple a toujours fait de la confidentialité une valeur fondamentale, et Apple Intelligence 2.0 ne fait pas exception. La plupart des tâches d’IA sont effectuées directement sur l’appareil, ce qui signifie que vos données personnelles ne sont jamais envoyées vers les serveurs d’Apple. Pour les tâches nécessitant plus de puissance de calcul, Apple utilise Private Cloud Compute, une infrastructure sécurisée où les données sont traitées dans des centres de données Apple sans être stockées ni accessibles.

Cette approche « edge AI » présente des avantages certains en matière de confidentialité, mais impose également des limitations en termes de complexité des modèles pouvant être exécutés. Les modèles les plus avancés restent sur les serveurs cloud d’Apple, ce qui crée une dépendance à la connectivité pour certaines fonctionnalités avancées.

Google Gemini 3 : La Réponse de Google à l’Ère de l’IA Mobile

Google répond à Apple avec Gemini 3, la dernière itération de son modèle de langage multimodal développé par Google DeepMind. Contrairement à Apple, Google adopte une approche cloud-first, exploitant la puissance de ses Tensor Processing Units (TPU) de cinquième génération pour offrir des performances de pointe qui surpassent largement ce que les processeurs mobiles peuvent offrir localement.

Gemini 3 se distingue par sa capacité à raisonner sur différents types de données simultanément : texte, images, audio, vidéo et même le code source. Cette multimodalité native en fait un outil extrêmement puissant pour les créateurs de contenu, les développeurs et les professionnels qui ont besoin d’analyser et de produire différents types de médias.

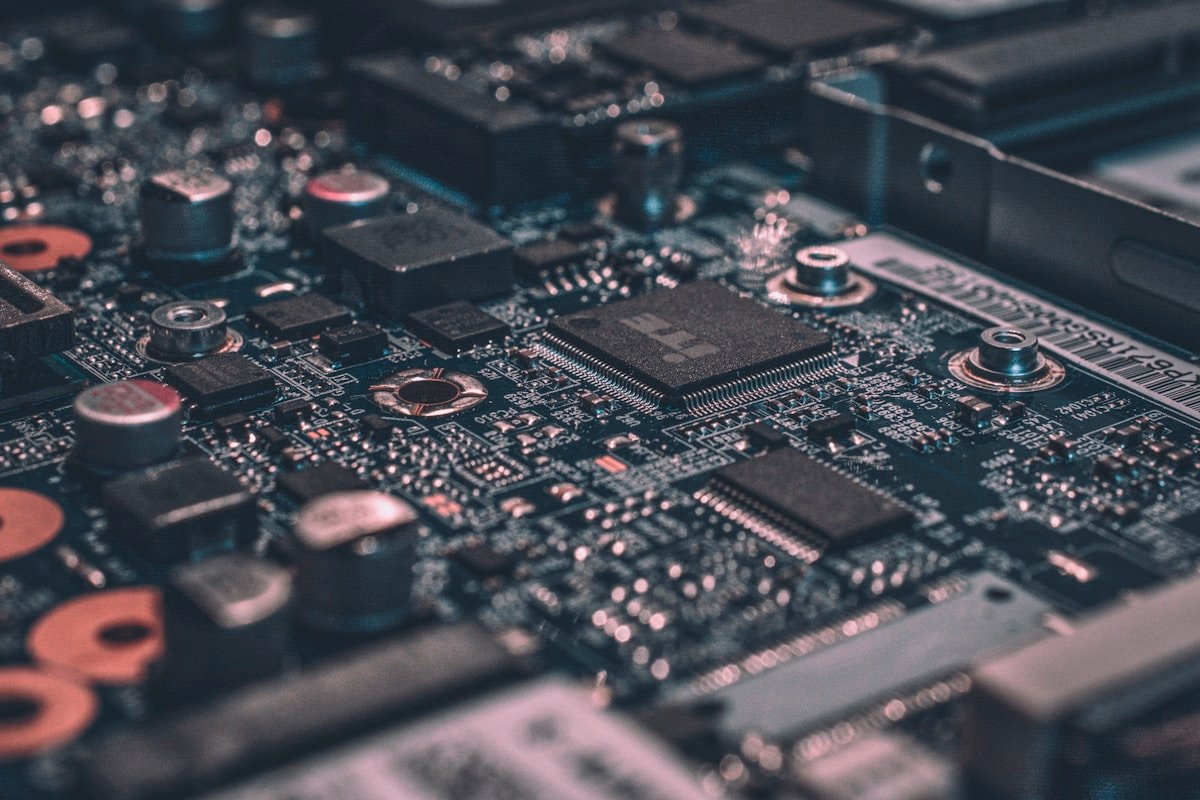

Gemini Nano : L’IA Locale sur Android

Pour maintenir un équilibre entre performance et confidentialité, Google a développé Gemini Nano, une version allégée du modèle conçue pour fonctionner localement sur les smartphones Android équipés de processeurs compatibles. Le Pixel 10 Pro, par exemple, intègre le Tensor G5 avec une unité de traitement neuronal (NPU) capable de gérer des tâches d’IA complexes sans connexion internet.

Photo : Serveurs de centre de données — Libre de droits via Unsplash

Cette approche hybride permet à Gemini Nano de gérer les tâches quotidiennes comme la transcription vocale hors ligne, la retouche photo intelligente, et les commandes vocales locales, tandis que les tâches plus complexes sont confiées aux serveurs cloud de Google. L’avantage de cette approche est une expérience utilisateur plus fluide et plus rapide pour les tâches courantes, sans sacrifier les fonctionnalités avancées.

Intégration Profonde avec l’Écosystème Google

Gemini 3 est profondément intégré dans l’écosystème Google. Sur Android 16, l’assistant Gemini remplace définitivement Google Assistant sur les appareils compatibles. L’assistant peut être invoqué par un glissement depuis le coin inférieur de l’écran ou par la commande « Hey Google » traditionnelle.

L’intégration avec Google Workspace est également renforcée. Gemini peut rédiger des documents dans Google Docs, créer des présentations dans Google Slides, analyser des données dans Google Sheets, et même programmer des événements dans Google Calendar en interprétant des requêtes en langage naturel. Pour les professionnels, cette intégration représente un gain de productivité significatif.

Gemini 3 Ultra : Le Modèle le Plus Puissant

Pour les utilisateurs exigeants, Google propose Gemini 3 Ultra, accessible via un abonnement Google One AI Premium. Ce modèle surpasse GPT-5 dans plusieurs benchmarks majeurs, notamment en raisonnement mathématique, en compréhension du code source et en résolution de problèmes complexes.

Gemini 3 Ultra peut passer des appels téléphoniques pour vous, négocier avec des prestataires de services, et même rédiger des e-mails longs et complexes en tenant compte du contexte émotionnel de vos conversations précédentes. Cette évolution vers des agents IA autonomes représente l’avenir de l’assistance personnelle numérique.

Comparatif Technique : Apple Intelligence 2.0 vs Google Gemini 3

Pour établir un comparatif objectif entre Apple Intelligence 2.0 et Google Gemini 3, il convient d’examiner plusieurs critères essentiels qui déterminent la qualité de l’expérience IA sur smartphone.

En termes de performance brute, Gemini 3 surclasse Apple Intelligence 2.0 sur les tâches complexes nécessitant un raisonnement profond. Les benchmarks standardisés montrent que Gemini 3 Ultra dépasse le modèle Apple de près de 15% sur les tâches de raisonnement logique et de 22% sur la génération de code. Cependant, Apple Intelligence 2.0 offre des temps de réponse plus rapides pour les tâches simples grâce à son exécution locale sur le Neural Engine de l’A19 Pro.

La confidentialité représente un axe de différenciation majeur. Apple Intelligence 2.0 excelle dans ce domaine avec son approche « privacy-first » où les données restent sur l’appareil. Google Gemini 3, bien qu’offrant des options de confidentialité robustes avec Gemini Nano, nécessite un envoi vers le cloud pour les fonctionnalités les plus avancées.

Photographie Computationnelle : L’IA au Service de la Photo

L’un des domaines où l’IA mobile impacte le plus directement le quotidien des utilisateurs est la photographie computationnelle. Apple et Google ont tous deux fait des avancées significatives dans ce domaine, en utilisant l’intelligence artificielle pour améliorer automatiquement la qualité des photos.

Apple Intelligence 2.0 apporte des améliorations significatives à l’application Appareil Photo. Le mode Portrait bénéficie désormais d’une détection de profondeur plus précise, permettant un flou d’arrière-plan plus naturel et des effets d’éclairage studio convaincants. La fonction « Suppression intelligente » permet de retirer des éléments indésirables de vos photos en un seul geste.

Google Gemini 3 pousse encore plus loin avec Magic Eraser nouvelle génération, capable de supprimer des éléments complexes comme des personnes en mouvement ou des objets partiellement occlus. L’outil Best Take fusionne automatiquement les meilleures expressions faciales de plusieurs photos similaires pour créer l’image parfaite de groupe.

Prix et Accessibilité : Quel Coût pour l’IA sur Mobile ?

Apple Intelligence 2.0 est inclus gratuitement avec les appareils compatibles exécutant iOS 27 : iPhone 16 Pro et ultérieur, iPad avec puce M1 ou ultérieure, et Mac avec puce Apple Silicon.

Google Gemini 3 offre un modèle plus nuancé. Gemini Nano est inclus gratuitement sur les Pixel et autres appareils Android compatibles. Pour les fonctionnalités avancées de Gemini 3 Ultra, Google propose un abonnement Google One AI Premium à 19,99 € par mois.

Verdict : Apple Intelligence 2.0 ou Google Gemini 3 ?

Le choix entre Apple Intelligence 2.0 et Google Gemini 3 dépend largement de votre écosystème existant et de vos priorités personnelles. Si vous êtes profondément investi dans l’écosystème Apple avec un iPhone, un Mac et un iPad, Apple Intelligence 2.0 offre une intégration plus profonde et plus fluide, avec une confidentialité accrue grâce à l’exécution locale.

Si en revanche vous utilisez un smartphone Android, notamment les Pixel ou les appareils Samsung Galaxy, Google Gemini 3 offre des fonctionnalités plus avancées et une intégration plus large avec l’écosystème Google. La connexion aux services Google Workspace et la puissance des modèles cloud de Google représentent des avantages significatifs pour les professionnels et les créateurs de contenu.

FAQ : Questions Fréquentes sur l’IA Mobile en 2026

Apple Intelligence 2.0 est-il disponible sur tous les iPhone ?

Non, Apple Intelligence 2.0 nécessite un matériel spécifique pour fonctionner correctement. Les appareils compatibles incluent l’iPhone 16 Pro et l’iPhone 16 Pro Max avec la puce A19 Pro, ainsi que les iPad et Mac équipés de puces Apple Silicon de génération M1 ou ultérieure.

Google Gemini 3 fonctionne-t-il hors ligne ?

Gemini Nano, la version locale de Gemini, fonctionne hors ligne pour les tâches basiques comme la transcription vocale et les commandes vocales locales. Pour les fonctionnalités avancées de Gemini 3 Ultra, une connexion internet est nécessaire.

Quelle est la différence entre l’IA locale et l’IA cloud ?

L’IA locale s’exécute directement sur le processeur de votre appareil, ce qui garantit une meilleure confidentialité et des temps de réponse plus rapides. L’IA cloud utilise les serveurs distants du fournisseur pour des tâches plus complexes, nécessitant une connexion internet mais offrant des performances supérieures.

Apple Intelligence 2.0 et Google Gemini 3 sont-ils disponibles en français ?

Oui, les deux systèmes supportent le français. Apple Intelligence 2.0 et Google Gemini 3 peuvent comprendre et produire du texte en français, avec des nuances contextuelles et idiomatiques. Les deux assistants vocaux (Siri 2.0 et Gemini) répondent en français.